2016年人工智能技術發展進程梳理 軟硬件技術開發的突破與融合

2016年是人工智能發展史上的關鍵一年,被視為AI技術從實驗室走向大規模應用的分水嶺。這一年,深度學習驅動的軟硬件技術開發取得了突破性進展,不僅推動了算法模型的優化與普及,更催生了專用硬件生態的初步形成,為后續的AI產業化浪潮奠定了堅實基礎。

一、 軟件與算法:從理論突破到框架普及

- 深度學習框架的“戰國時代”與生態構建:以谷歌TensorFlow(2015年底發布,2016年全面推廣)、Facebook PyTorch(前身Torch的Python版本開始受到關注)、微軟CNTK以及百度的PaddlePaddle為代表的開源深度學習框架進入激烈競爭與快速發展期。TensorFlow憑借其強大的生產部署能力和谷歌的生態支持,迅速成為工業界和學術界的主流選擇之一,極大地降低了AI模型開發與部署的門檻,促進了技術民主化。

- 生成模型的萌芽與關注度提升:生成對抗網絡(GAN)在2014年提出后,經過兩年的發展,在2016年開始受到更廣泛的研究關注。Ian Goodfellow等人的工作引發了社區對生成式AI的濃厚興趣,盡管此時其應用尚處早期,但已為未來圖像生成、數據增強等領域埋下了革命性的種子。

- 強化學習的標志性勝利:谷歌DeepMind的AlphaGo在2016年3月以4:1戰勝世界圍棋冠軍李世石,這是AI史上里程碑式的事件。它不僅是算法(結合了深度神經網絡、蒙特卡洛樹搜索和強化學習)的勝利,更向世界直觀展示了深度強化學習在解決復雜序列決策問題上的巨大潛力,引爆了全球對AI的關注與投資熱情。

- 自然語言處理的漸進變革:雖然Transformer架構(2017年)尚未問世,但基于LSTM/GRU等循環神經網絡的序列模型在機器翻譯、文本生成等任務上持續進步。注意力機制(Attention Mechanism)的概念被更廣泛地研究和應用,為后續Transformer的誕生做了重要鋪墊。詞向量(如Word2Vec, GloVe)作為標準預處理技術被廣泛應用。

二、 硬件與基礎設施:專用化計算的興起

- GPU計算的鞏固與普及:英偉達(NVIDIA)繼續引領潮流。其基于Pascal架構的GPU(如Tesla P100)專門針對深度學習進行了優化,并發布了NVLink高速互聯技術,提升了多GPU訓練的效率。英偉力推的CUDA并行計算平臺和cuDNN深度學習加速庫,構成了當時AI硬件開發的事實標準,使得GPU成為AI訓練和推理不可或缺的算力引擎。

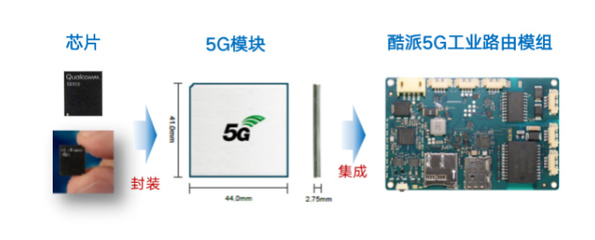

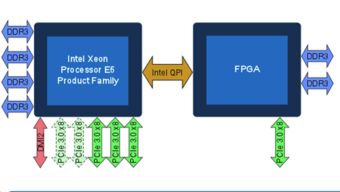

- 專用AI芯片的初步探索與發布:業界開始積極探索超越通用GPU的專用硬件。谷歌在這一年首次正式披露了其自主研發的張量處理單元(TPU),并宣布已在其數據中心內部署,用于加速神經網絡推理(特別是用于AlphaGo)。TPU的亮相標志著科技巨頭開始為AI負載量身定制硬件,追求更高的能效比和性能,開啟了AI計算專用化的新篇章。

- 云端AI服務成為主流商業模式:亞馬遜AWS、谷歌云平臺(GCP)、微軟Azure等主流云服務商紛紛推出或完善其機器學習云服務(如AWS的機器學習服務、谷歌的Cloud ML Engine)。它們將強大的GPU算力、預訓練的模型和易用的開發工具以云服務的形式提供,使得中小企業甚至個人開發者無需巨額硬件投資即可使用先進的AI能力,加速了AI技術的滲透和落地。

- 邊緣計算與終端AI的早期信號:隨著移動設備性能提升和物聯網發展,業界開始關注在終端設備上進行AI推理的需求。雖然專用的邊緣AI芯片(如后來的華為麒麟970 NPU、蘋果A11神經引擎)尚未大規模上市,但針對計算機視覺等應用的輕量級模型研究和低功耗推理優化已成為重要研究方向。

三、 軟硬件協同與行業影響

2016年,AI軟硬件技術的發展呈現出強烈的協同效應:更復雜、更強大的算法模型(如深度強化學習網絡)對算力提出了貪婪的需求,驅動了GPU和TPU等硬件的創新與部署;反過來,更強大的算力又使得研究人員能夠訓練更大、更深層的模型,探索更復雜的任務。這種良性循環極大地加速了技術進步。

以AlphaGo事件為引爆點,AI從科技圈的熱門話題迅速轉變為全球性的社會關注焦點,吸引了前所未有的資本、人才和政策投入。各行各業開始認真探索AI與自身業務的結合點,“AI+”的浪潮開始涌動。

****

2016年的人工智能技術發展,在軟件層面表現為主流開源框架的確立和生成式、強化學習等前沿方向的蓬勃生長;在硬件層面則標志著從通用計算向專用AI計算的戰略轉向。這一年,技術突破、基礎設施完善與公眾認知覺醒交織在一起,共同將人工智能推向了新一輪爆發性增長的起點,其定義的許多技術路徑和生態格局,持續影響著此后數年AI產業的發展軌跡。

如若轉載,請注明出處:http://m.tjzhouda.cn/product/41.html

更新時間:2026-02-23 16:29:33